Table of Contents

Imaginez recevoir un appel vidéo urgent de votre PDG vous demandant de transférer des fonds sur un compte étranger. Sa voix, ses expressions faciales, et même ses tics de langage semblent parfaitement authentiques. Pourtant, il s’agit d’une arnaque élaborée grâce à une technologie d’intelligence artificielle (IA) appelée deepfake. Ce type d’attaque, en plein essor depuis 2019, représente l’une des menaces les plus sournoises et sophistiquées en cybersécurité.

L’évolution des deepfakes : De l’expérimentation à l’arme de fraude

Avant 2019 : Les premières briques technologiques

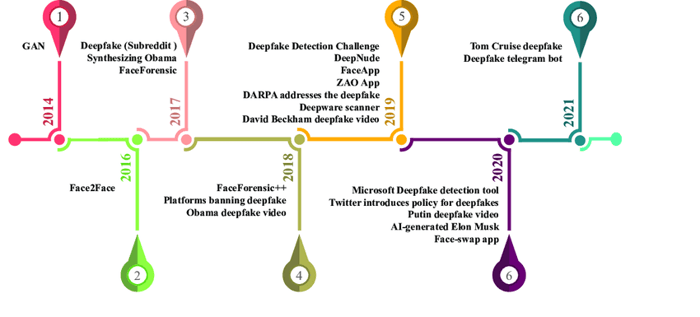

Pour comprendre la menace, il faut remonter à ses origines. En 2014, la publication de l’article scientifique sur les GAN (Generative Adversarial Networks) a jeté les bases de la génération d’images de synthèse de plus en plus réalistes. En 2016, la mise en ligne sur GitHub du projet Face2Face a permis d’expérimenter la manipulation de visages en temps quasi réel.

Vers 2017, les premiers deepfakes sont apparus, principalement utilisés pour créer des vidéos humoristiques ou des effets spéciaux, encore loin des usages malveillants que l’on observe aujourd’hui.

2019-2023 : L’ère de l’émergence

À partir de 2019, on constate les premiers abus : fausses déclarations de politiciens, revenge porn, fraudes financières rudimentaires, etc. En parallèle, la technologie des deepfakes se démocratise. L’émergence de bots sur Telegram et de plateformes en ligne permet désormais de générer des vidéos ou des enregistrements à partir de simples échantillons sonores ou visuels, rendant ces outils accessibles à un large public sans compétences techniques avancées.

Au fil des années 2020 et 2021, des cas médiatisés de deepfakes de célébrités (acteurs, chefs d’État, PDG) ont mis en lumière la facilité avec laquelle l’opinion publique peut être trompée. Des comptes TikTok parodiant des personnalités comme Tom Cruise ont montré que même un usage divertissement peut semer le doute sur l’authenticité des contenus.

2023-2025 : L’ère de l’industrialisation

Avec l’arrivée d’outils grand public comme DeepFaceLab ou Wav2Lip, même des non-experts peuvent générer des deepfakes en quelques clics. Parallèlement, sur des forums clandestins et des places de marché du dark web, des services « clé en main » se multiplient. D’après une enquête de Check Point Research, il serait possible de commander une vidéo de 30 secondes imitant un dirigeant pour environ 500 €.

En 2024 et 2025, on assiste à une industrialisation des deepfakes : des groupes criminels se spécialisent dans la fraude par usurpation d’identité visuelle et vocale, visant principalement des entreprises et des organisations politiques. Les techniques de détection, bien que de plus en plus performantes, peinent à suivre la rapidité des avancées technologiques.

Exemple concret: Fraude au PDG

Un cas inhabituel de fraude au PDG a utilisé un audio deepfake, généré par l’intelligence artificielle (IA), et aurait extorqué 243 000 $US à une entreprise d’énergie basée au Royaume-Uni. Selon un rapport du Wall Street Journal, les fraudeurs ont utilisé un logiciel de génération vocale par IA pour imiter la voix du dirigeant de la société mère allemande et ainsi faciliter un transfert de fonds illégal.

Les cybercriminels ont appelé le PDG de la filiale britannique en prétendant être le PDG de la maison mère. Ils ont exigé un virement urgent vers un fournisseur basé en Hongrie, en assurant le dirigeant britannique d’un remboursement ultérieur. Après l’exécution du virement, l’argent a été transféré vers un compte au Mexique puis acheminé vers d’autres destinations, rendant l’identification des fraudeurs plus complexe.

Les malfaiteurs ont ensuite rappelé pour demander un second virement, prétextant que le premier avait déjà été remboursé. Constatant que le remboursement n’était pas effectif, le PDG britannique a refusé. Lors d’un troisième appel, les escrocs ont renouvelé leur demande, mais la suspicion était déjà installée, d’autant plus que l’appel provenait cette fois d’un numéro autrichien.

Plongée dans les coulisses technologiques

Comment fonctionne un deepfake ?

Le processus repose sur des réseaux neuronaux antagonistes (GAN). Imaginez un faussaire (le générateur) qui crée une imitation, et un détective (le discriminateur) qui tente de la démasquer. À force d’entraînement, le faussaire devient si habile que même le détective s’y trompe.

Étapes clés :

Collecte de données : Photos, vidéos, ou enregistrements de la cible (provenant souvent de LinkedIn, de conférences YouTube, ou de podcasts).

Entraînement du modèle : L’IA étudie les expressions, la tonalité vocale, et même les pauses respiratoires.

Génération : Création d’un contenu falsifié synchronisé avec les mouvements et le contexte souhaité.

Cas concret : En 2024, Le Dr Michel Cymès, médecin et animateur très populaire en France, a récemment attaqué Meta en justice après la diffusion de publicités frauduleuses qui utilisaient son image grâce à des deepfakes. Des arnaqueurs, visant souvent un public plus âgé, détournent l’image de « médecins de télévision » pour faire de la promotion et de la publicité à des faux remèdes et médicaments.

De la même façon, le Britannique Hilary Jones a vu son visage et sa voix réutilisés pour promouvoir de faux remèdes contre l’hypertension ou des gommes au chanvre : « Même quand ces publicités sont supprimées, elles réapparaissent le lendemain sous un autre nom », regrette-t-il dans une interview.

De nos jours, ces technologies sont disponbile et accessible au grand public. Sachez que pour moins que le prix d'un café au lait et en moins de 10 minutes, les escrocs peuvent créer des vidéos deepfake étonnamment convaincantes.

Pourquoi le deepfake phishing est-il une bombe à retardement ?

Les deepfakes ne sont plus une technologie futuriste, mais une réalité quotidienne. Voici ce qu’a démontré l’enquête de McAfee :

- 59 % des personnes dans le monde connaissent quelqu’un qui a été victime d’une escroquerie en ligne, et ce chiffre passe à 77 % chez les 18-24 ans.

- Les escrocs misent sur la rapidité : 64 % des escroqueries entraînent une perte financière ou un vol de données personnelles dans l’heure qui suit.

- La détresse émotionnelle s’ajoute aux pertes monétaires, 35 % des victimes subissant un stress important.

Le deepfake n’est pas une technique ordinaire d’ingenierie sociale, et ce a cause des facteurs suivants :

La trahison des sens humains

Notre cerveau est programmé pour faire confiance à ce qu’il voit et entend. Une étude de l’Université Stanford montre qu’un deepfake bien exécuté trompe 92 % des personnes non averties.

L’effet de « bulle de confiance »

Les attaques ciblent souvent des employés ayant un accès limité aux décideurs. Une assistante de direction recevant une « demande urgente » du PDG via Teams aura moins de réflexes de vérification qu’avec un e-mail.

La course contre la détection

Les outils de détection (comme Microsoft Video Authenticator) cherchent des anomalies – pixels asymétriques, synchronisation labiale imparfaite. Mais les deepfakes de dernière génération intègrent désormais des micro-expressions et des imperfections réalistes (toux, hésitations).

Arsenal de défense : Stratégies concrètes pour entreprises et individus

Pour les organisations

Protocole de vérification renforcé :

Règle des « deux canaux » : Toute demande sensible doit être confirmée par un canal distinct (ex. : visio + SMS crypté).

Mots de passe dynamiques : Une phrase codée connue uniquement en interne (« Quel était le dessert de la pause café mardi ? »).

Formation immersive :

Ateliers avec des deepfakes réalistes créés sur mesure pour l’entreprise.

Apprendre à repérer les indices : Absence d’émotion dans les pupilles, fond vidéo flou ou répétitif, incohérences contextuelles (« Pourquoi le PDG me demanderait-il cela directement ? »).

Pour les particuliers

Vérification systématique :

Face à une demande étrange, raccrochez et rappelez le numéro officiel de la personne.

Posez une question personnelle que seule la vraie personne connaît (« Comment s’appelait notre professeur de CM2 ? »).

Hygiène numérique :

Limitez les publications de voix (podcasts, messages vocaux publics).

Exploitez efficacement les paramètres de confidentialité sur les réseaux sociaux.

Outils grand public : Des services comme "Deepware scanner" et "Resemble Detect" qui analysent des fichiers multimedia pour détecter les deepfakes.

Et vous dans tout cela ?

A mon avis, la défense contre les deepfakes ne repose pas que sur la technologie, mais sur une culture collective de la méfiance saine. Chaque fois que vous recevez une demande inhabituée, prenez 5 minutes pour :

Respirer ! Vu que ce genre d'attaques misent sur la précipitation.

Vérifier ! Deux canaux, une question piège.

Signaler ! Même en cas de doute, alertez votre service de sécurité IT.

J’ai choisi de rédiger cet article parce que vous, internautes, travaillez déjà dans de grandes entreprises ou en ferez partie très prochainement. Avec l’émergence de cette menace, vous serez sûrement amenés à y faire face, même si vous n’êtes pas directement ciblés : quelqu’un dans votre entourage le sera. Au moins, vous saurez maintenant quoi faire.

Question pour vous : Si vous deviez créer un « mot de passe humain » avec un proche (une phrase ou un souvenir impossible à deviner pour une IA), quel serait-il ? Partagez vos idées pour inspirer la communauté !